Robot e A.I.: questioni di soggettività giuridica

di Davide Alesso

Premessa

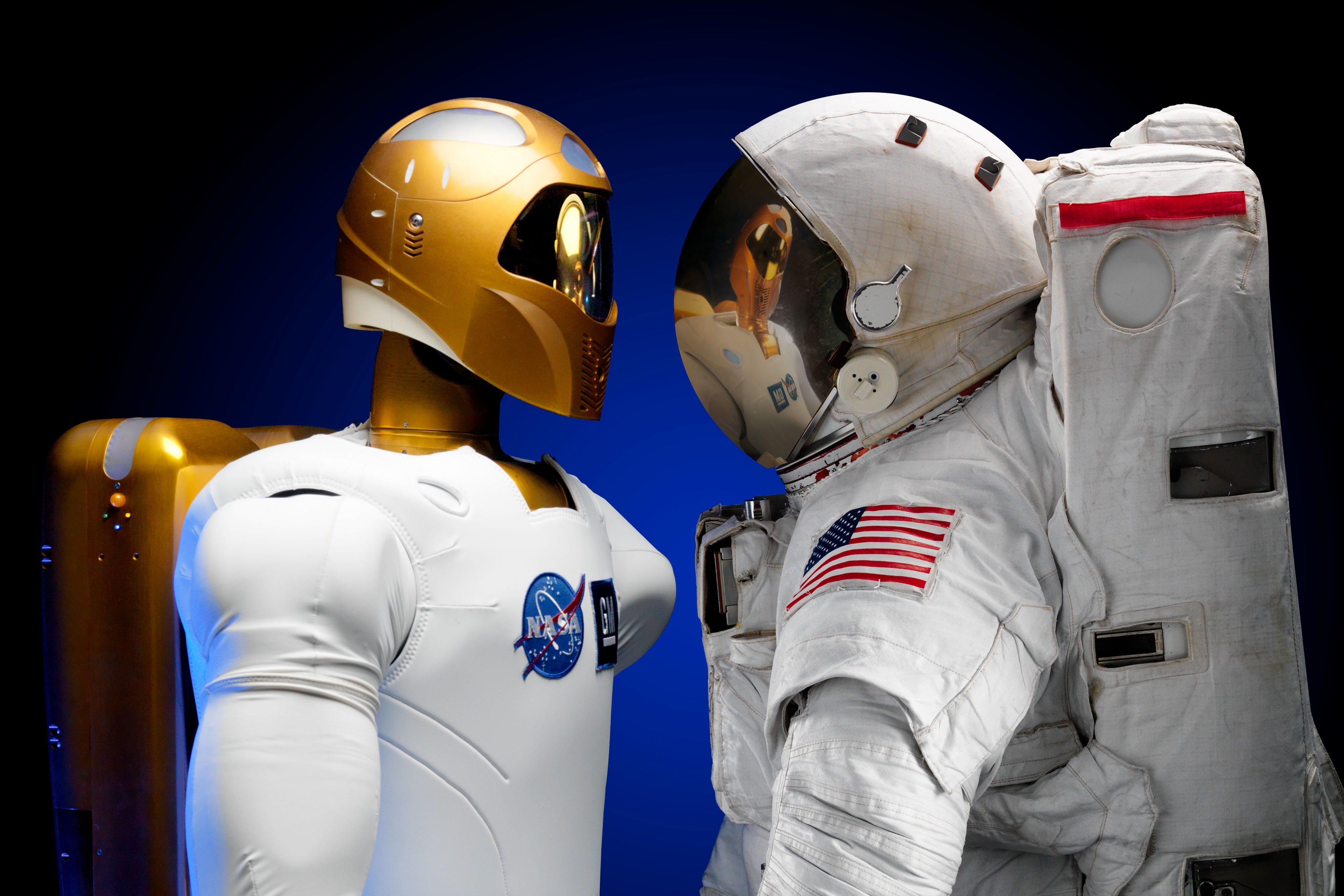

Il costante e inarrestabile progresso tecnologico sta comportando un profondo mutamento della vita quotidiana degli individui, sia dal punto di vista sociale che dal punto di vista professionale. Basti pensare alle innovazioni tecnologiche nel campo sanitario, nell’automazione industriale e nel settore automobilistico che stanno progressivamente conducendo a una interazione abituale fra uomo e macchine. Oltre alla discussione scientifica su queste nuove tecnologie avanzate, la rapida diffusione di robot e altre manifestazioni dell’intelligenza artificiale (“A.I.”) rende imprescindibile un’analisi giuridica da parte dei legislatori europei e nazionali. Le implicazioni giuridiche derivanti dall’introduzione di robot possono ricondursi a diversi temi fra cui si citano, ad esempio, la responsabilità dei robot, la tassazione degli stessi, nonché la sicurezza sul luogo di lavoro.

Le prospettive giuridiche europee

Sebbene non esista, dal punto di vista strettamente giuridico, una definizione univoca ed esaustiva, il termine “robot”[1] fa generalmente riferimento a una macchina che svolge autonomamente uno o più lavori[2]. La normativa europea e quelle nazionali hanno fornito, da diverso tempo, le basi giuridiche per la regolamentazione dei robot intesi come prodotti, soprattutto a causa del loro coinvolgimento costante e quotidiano nelle attività dell’uomo e, in particolare, per i danni cagionati all’uomo dai “robot-prodotto”. Tali normative, fra cui si cita per esempio la direttiva 2006/42/CE (cd. “direttiva macchine”), disciplinano fra le altre cose la progettazione e la costruzione delle macchine, occupandosi degli aspetti legati alla salvaguardia della salute e della sicurezza per soddisfare livelli di protezioni adeguati per gli utilizzatori. E’ evidente che tali interventi normativi del legislatore europeo hanno lo scopo preciso di tutelare i consumatori nell’ambito del mercato comunitario[3]. Tuttavia, il progressivo sviluppo della tecnologia robotica porta inevitabilmente a un ripensamento della qualificazione giuridica dei robot, i quali non possono più essere considerati meramente oggetti al servizio dell’attività umana, ma possono essere veri e propri agenti. In questa direzione, il tentativo di individuazioni di norme connesse alla soggettività e altre intelligenze artificiali è oggetto attuale di discussione all’interno delle istituzioni europee che, recentemente, hanno preso posizione sulla questione. In particolare, nel febbraio 2017, il Parlamento europeo ha approvato una risoluzione recante raccomandazioni alla Commissione concernenti norme di diritto civile sulla robotica[4], frutto delle attività di un apposito gruppo di lavoro, che ha affrontato le questioni legali emergenti dai risultati di Robolaw[5], un progetto di ricerca finalizzato alla stesura della nuova legislazione europea sulla robotica. La risoluzione sottolinea come anche i robot dovranno rispettare le leggi vigenti, non solo le cd. leggi di Asimov[6]. Tale ultima affermazione pone delle implicazioni sul piano giuridico, in quanto presuppone che i robot siano legalmente responsabili per le proprie attività. Ciò è dovuto al fatto che, nell’ultimo decennio, il progresso tecnologico ha reso i robot capaci non solo di svolgere attività che tipicamente erano svolte dagli umani, ma li ha dotati di caratteristiche autonome e cognitive. I robot moderni, infatti, sono caratterizzati da capacità cognitive avanzate che permettono loro un adattamento e un’interazione con l’ambiente circostante in cui operano, con una inevitabile componente di imprevedibilità di comportamento. Ed è proprio l’imprevedibilità di comportamento l’aspetto più significativo e complesso che necessita un adattamento delle norme sulla responsabilità civile, sia contrattuale che extracontrattuale. Il quadro normativo attuale sembra però non essere sufficientemente evoluto per far fronte alle nuove esigenze, soprattutto con riferimento alla responsabilità dei robot-agenti che cagionano un danno. Per quanto concerne l’ordinamento giuridico italiano, il quesito che ci si dovrebbe porre è se le attuali norme sulla responsabilità civile possano essere adattate e interpretate alla luce dei nuovi scenari. Si pensi ad esempio all’articolo 2043 c.c. relativo alla responsabilità da fatto illecito, nel quale il termine “colui”, ovvero il soggetto che è tenuto a risarcire il danno ingiusto causato a seguito di un fatto doloso o colposo, possa essere interpretato non solo come individuo umano, ma anche nell’accezione di soggetto elettronico[7]. Considerare i robot come soggetti autonomi, implica che essi debbano necessariamente essere regolati da norme che prevedano una responsabilità per azioni od omissioni degli stessi, qualora le cause di responsabilità non possano essere riconducibili a un soggetto umano specifico come, ad esempio, il fabbricante, il proprietario o l’utilizzatore. La prospettiva è dunque quella di identificare un tertium genus, titolare di diritti e doveri, diverso rispetto alle tradizionali figure della persona fisica e giuridica[8]. La ratio dell’introduzione di un terzo soggetto giuridico che possa essere titolare di rapporti giuridici è quella di poter essere in grado di risarcire il soggetto a cui è stato causato il danno. Nella prospettiva di una normazione in materia di responsabilità civile, il Parlamento europeo ha sottolineato la necessità di istituire un regime assicurativo obbligatorio, che potrebbe basarsi sull’obbligo del produttore di stipulare una copertura assicurativa per i robot autonomi. Tale assunto parte dal presupposto che, almeno nella fase attuale, la responsabilità debba essere attribuita all’essere umano e non direttamente al robot, come ribadito dal punto 56 della risoluzione[9].

Conclusioni

La breve e non esaustiva disamina delle problematiche relative alla soggettività dei robot e delle intelligenze artificiali, consente di fare una prima analisi sulle prospettive future. La costante crescita del mercato e l’evoluzione tecnologica necessitano sempre più una concreta presa di posizione da parte delle autorità nazionali e sovranazionali, le quali saranno chiamate ad intervenire sugli attuali quadri giuridici. L’individuazione di un tertium genus e di una “persona elettronica” sembra essere imprescindibile, al di là dello strumento legislativo che verrà utilizzato, per regolare le complesse implicazioni giuridiche che l’attività dei robot comporta, prima fra tutte, come accennato, la responsabilità civile. La sfida, dunque, sembra essere, ancora auna volta, quella di ripensare gli istituti giuridici tradizionali degli ordinamenti per adattarli alle nuove necessità del mondo tecnologico.

Bibliografia:

[1] Il termine robot, derivante dal termine ceco ‘robota’, che significa letteralmente “lavoro pesante” o “lavoro forzato”, venne usato per la prima volta nel 1920 dallo scrittore ceco Karel Čapek nell’opera Rosum’s Universal Robots.

[2] A. SANTOSUOSSO, C. BOSCARATI, F. CAROLEO, “Robot e diritto. Una prima ricognizione” in La nuova giurisprudenza civile commentatan. 7-8/2012, pag. 498.

[3] Fra le altre normative europee, si segnalano: la direttiva n. 2001/95/CE relativa alla sicurezza generale dei prodotti; la decisione 768/2008/CE relativa a un quadro comune per la commercializzazione dei prodotti; il regolamento 765/2008/CE che pone norme in materia di accreditamento e vigilanza del mercato per quanto riguarda la commercializzazione dei prodotti.

[4] Risoluzione del Parlamento europeo del 16 febbraio 2017 recante raccomandazioni alla Commissione concernenti norme di diritto civile sulla robotica (2015/2013/INL)). Reperibile su: http://www.europarl.europa.eu/sides/getDoc.do?pubRef=-//EP//TEXT+REPORT+A8-2017-0005+0+DOC+XML+V0//IT#title1

[5] Il progetto Robolaw è un progetto di ricerca finanziato dalla Commissione europea e coordinati dalla Scuola Superiore Sant’Anna di Pisa in materia di robotica. Per maggiori informazioni, si veda: http://www.robolaw.eu/

[6] Le “Tre leggi sulla robotica”ideate nel 1940 da Isaac Asimov, scrittore e biochimico russo, nel suo “Manuale di Robotica”, sono le seguenti: (i) “Un robot non può recar danno a un essere umano né può permettere che a causa del proprio mancato intervento un essere umano riceva danno”; (ii) “Un robot deve obbedire agli ordini impartiti dagli esseri umani purché tali ordini non contravvengano alla prima legge”; (iii) “Un robot deve proteggere la propria esistenza purché questo non contrasti con la prima e la seconda legge”.

[7] S. ORITI, “Brevi note sulla risoluzione del Parlamento europeo del 16 febbraio 2017 concernente le norme di diritto civile sulla robotica”. Reperebile su: http://www.ratioiuris.it/wp-content/uploads/2017/07/Brevi-note-sulla-risoluzione-del-Parlamento-europeo-del-16-febbraio-2017-concernente-le-norme-di-diritto-civile-sulla-robotica-1.pdf

[8] In tal senso, la Risoluzione del Parlamento europeo sopra citata al punto 59, lettera f) prevede: “l’istituzione di uno status giuridico specifico per i robot nel lungo termine, di modo che almeno i robot autonomi più sofisticati possano essere considerati come persone elettroniche responsabili di risarcire qualsiasi danno da loro causato, nonché eventualmente il riconoscimento della personalità elettronica dei robot che prendono decisioni autonome o che interagiscono in modo indipendente con terzi”.

[9] Risoluzione, punto 56: “una volta individuati i soggetti responsabili in ultima istanza, la loro responsabilità dovrebbe essere proporzionale all’effettivo livello di istruzioni impartite al robot e al grado di autonomia di quest’ultimo, di modo che quanto maggiore è la capacità di apprendimento o l’autonomia di un robot e quanto maggiore è la durata della formazione di un robot, tanto maggiore dovrebbe essere la responsabilità del suo formatore; osserva in particolare che, nella determinazione della responsabilità reale per il danno causato, le competenze derivanti dalla “formazione” di un robot non dovrebbero essere confuse con le competenze che dipendono strettamente dalle sue abilità di autoapprendimento; osserva che, almeno nella fase attuale, la responsabilità deve essere imputata a un essere umano e non a un robot”.

Autore: